Im finsteren Tal

Indizien, aber kein Beweis: Netzfund, KI.

Das Uncanny Valley – das „unheimliche Tal“ – beschreibt jenes psychologische Phänomen, bei dem uns eine menschenähnliche Figur gerade deshalb irritiert, weil sie fast echt wirkt. Fast – aber eben nicht ganz. Ein Roboter, eine Animation, ein digitales Gesicht: Je näher sie dem Menschen kommen, desto stärker kann das Gefühl des Unheimlichen werden, sobald ein winziger Rest von Künstlichkeit sichtbar bleibt.

Das erste Mal wurde dies einer breiteren Öffentlichkeit mit dem Erscheinen des ersten Shrek (2001) bewusst. Das Studio war technisch bereits in der Lage, eine deutlich realistischere Fiona – in ihrer menschlichen Form – zu berechnen, stellte jedoch in Tests fest, dass die weniger real anmutende Version auf höhere Akzeptanz stieß als die für damalige Verhältnisse realistischere Darstellung. Die beinahe perfekte Simulation erzeugte Irritation statt Identifikation. Der Begriff selbst reicht allerdings weiter zurück: Ende der 1970er Jahre beschrieb der japanische Robotiker Masahiro Mori dieses Phänomen erstmals als „uncanny valley“ – als jenen Punkt, an dem steigender Realismus nicht mehr zu größerer Nähe, sondern zu Abstoßung führt.

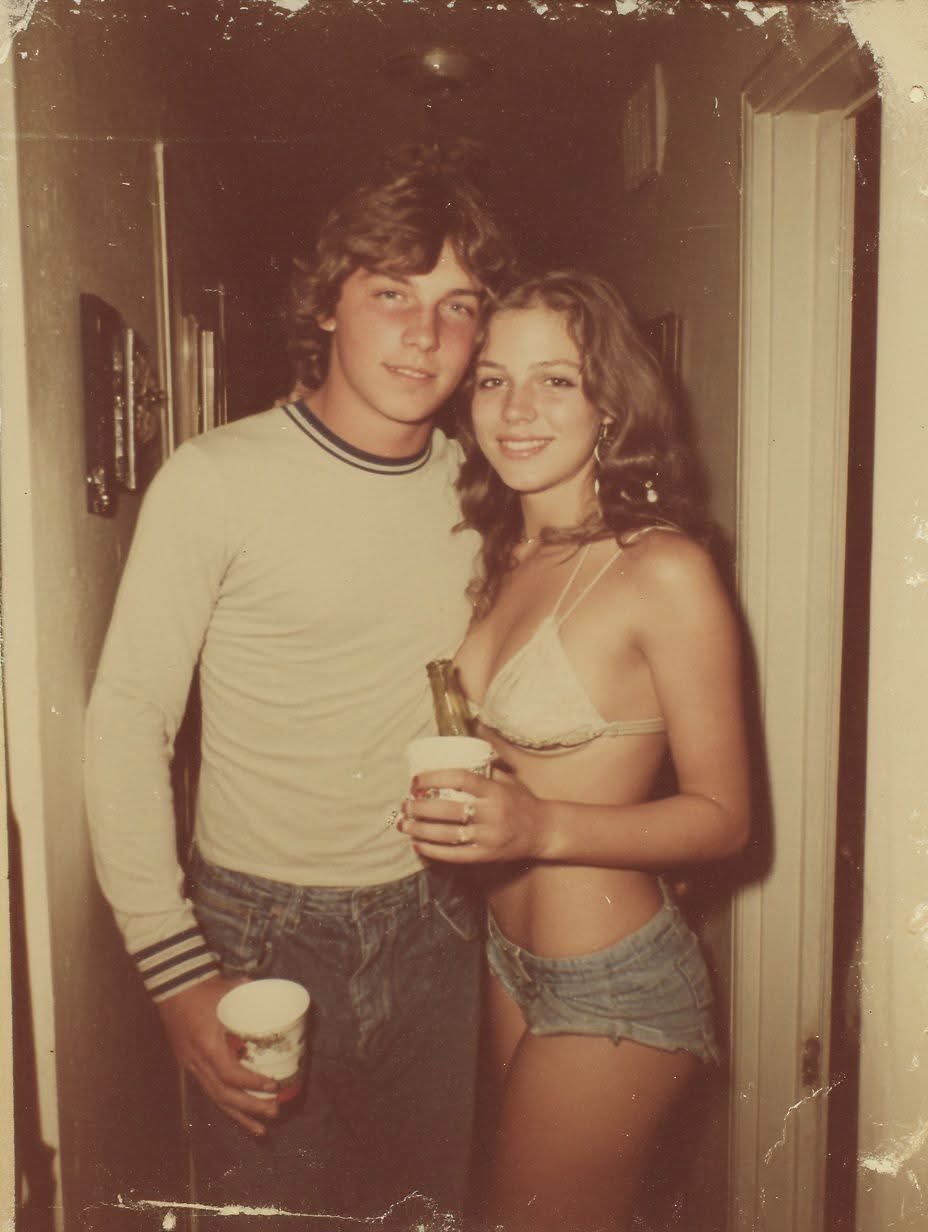

In den sozialen Medien kursiert – neben vielen anderen – eine Fotografie, die, aus meiner Sicht, genau in diesem Tal liegt. Sie ist wohl – mit hoher Wahrscheinlichkeit – KI-generiert; dieser Ursprung ist jedoch nicht eindeutig nachweisbar. Irgendetwas stimmt nicht. Und zugleich ist alles so stimmig, dass gerade diese Perfektion im Imperfekten verdächtig wird.

Das perfekte Relikt

Das Bild zeigt ein junges Paar, Ende der siebziger oder Anfang der achtziger Jahre. Vermutlich auf einer Party, in einem schmalen Flur eines Einfamilienhauses irgendwo in den USA. Es ist das perfekte Social-Media-Relikt für den Satz: früher war alles besser – die Partys, die Beziehungen, die Leichtigkeit des Seins. Körnung, Farbverschiebung, Kratzer, leicht vergilbter Rand – all die Spuren analoger Vergangenheit sind vorhanden. Zu vorhanden.

Eine umgekehrte Bildsuche führt ins Leere der Gegenwart: Das Foto taucht erst seit wenigen Wochen im Netz auf. Vermeintlich ältere Fundstellen in sozialen Netzwerken erweisen sich als trügerisch; Suchmaschinen datieren nicht das Bild, sondern den jeweiligen Ursprungspost. Wäre das Foto echt, müsste es längst vor dem Zeitalter generativer Bildmodelle existiert haben. Doch offenbar ist genau das nicht der Fall.

Das Kujau-Paradoxon

Die KI selbst hilft hier nicht weiter. Die Frage, ob dies KI sei, wird verlässlich mit Nein beantwortet – ganz gleich ob Grok, Gemini, Claude oder Chat. Nur Gemini äußert gleichzeitig Zweifel; für alle anderen ist der Fall klar. Damit entsteht eine eigentümliche Situation: Die Systeme, die Bilder generieren können, erkennen ihre eigenen möglichen Produkte nicht mehr eindeutig.

Zugleich fragen zahlreiche Betrachter eben diese KI, ob das Bild echt sei – und lassen ihre eigenen Zweifel vom möglichen Ersteller der Fotografie beruhigen. Es erinnert an Kujau, den Stern und die Hitler-Tagebücher: Wir fragen den Fälscher, ob er die Echtheit bestätigen kann.

Indizien ohne Beweis

So echt das Bild wirkt, so falsch könnte es sein. Und doch: Kein Detail liefert den endgültigen Beweis. Die Finger vielleicht einen Hauch zu lang – aber nicht unmöglich. Der knappe Bikini der jungen Frau durchaus denkbar für jene Zeit, ebenso die sehr kurzen Hotpants. Die Bierflasche etwas ungelenk gehalten, die Torso-Linien überdramatisiert, beinahe wie eine Frau ohne Unterleib – und dennoch: Alles ließe sich erklären. Jedes einzelne Detail bewegt sich innerhalb der statistischen Möglichkeiten des Realen. Indizien, aber kein Beweis eines synthetischen Ursprungs.

Netzfund – der vermutliche Ursprung der KI-Fotografie: Die Trägheit der KI hat Elemente (Bündchen, Flasche, aber auch Location und Perforationen) „mitgenommen“ bzw. in das spätere Ergebnis übertragen. Beweise? Keine. Nur ein Gefühl ...

Die umgekehrte Bildsuche zeigt jedoch noch eine andere, wohl authentische Fotografie, da sie sicher älter datiert. Ebenfalls ein junges Paar, ebenfalls mit Becher und Bierflasche – nur nicht so perfekt passend in die heutige Rückprojektion. Sondern genau so, wie es damals wohl war: weniger perfekt, weniger sexualisiert, mehr fettige Haare und pubertäre Unsicherheit. Es steht zu vermuten, dass diese Fotografie der Ursprung der KI-Generation war – mit der Vorgabe, sie konsumiger zu machen, glatter, anschlussfähiger an unsere Erinnerungen. Nicht an die Realität der Zeit, sondern an das Bild, das wir heute von ihr haben möchten.

Simulation der Sehnsucht

Die KI-Realität bedient genau diesen Wunsch: dass es damals besser war, weniger Tattoos, mehr Haut, mehr Party. Wir werden uns in Zukunft unsere Erinnerung passgenau generieren. Das Bild zeigt nicht mehr, was gewesen ist, sondern wie wir es uns in der Rückschau wünschen.

Die Grenze, an der KI-Bilder noch eindeutig identifizierbar waren, liegt bereits hinter uns. Das Offensichtliche ist verschwunden. Was bleibt, ist nur noch ein Gefühl: dieses leichte Abstoßen, gepaart mit Faszination. Das Uncanny Valley als letzte Detektionsinstanz.

Doch selbst dieses Gefühl wird nicht bleiben. Angesichts der Geschwindigkeit, mit der generative Systeme lernen, wird auch das unheimliche Tal sich schließen. Vielleicht in Monaten, vielleicht in Wochen, vielleicht in Tagen. Dann wird es keine ästhetische Irritation mehr geben, keinen Rest von Fremdheit, keinen sensorischen Widerstand. Das Bild wird nicht mehr fast echt sein. Es wird einfach echt wirken.

Und genau das zeigt sich bereits in den Diskussionen um dieses Bild: Es wirkt echt, es entspricht meinen Erinnerungen – warum sollte es dann eine Rolle spielen, ob es KI ist? Wir werden nicht mehr wissen, ob wir einer Erinnerung begegnen – oder ihrer Simulation. Und es wird keine Rolle mehr spielen.