Die Hysterie der Algorithmen: das Leinenhemd als Leichenhemd der Kreativität

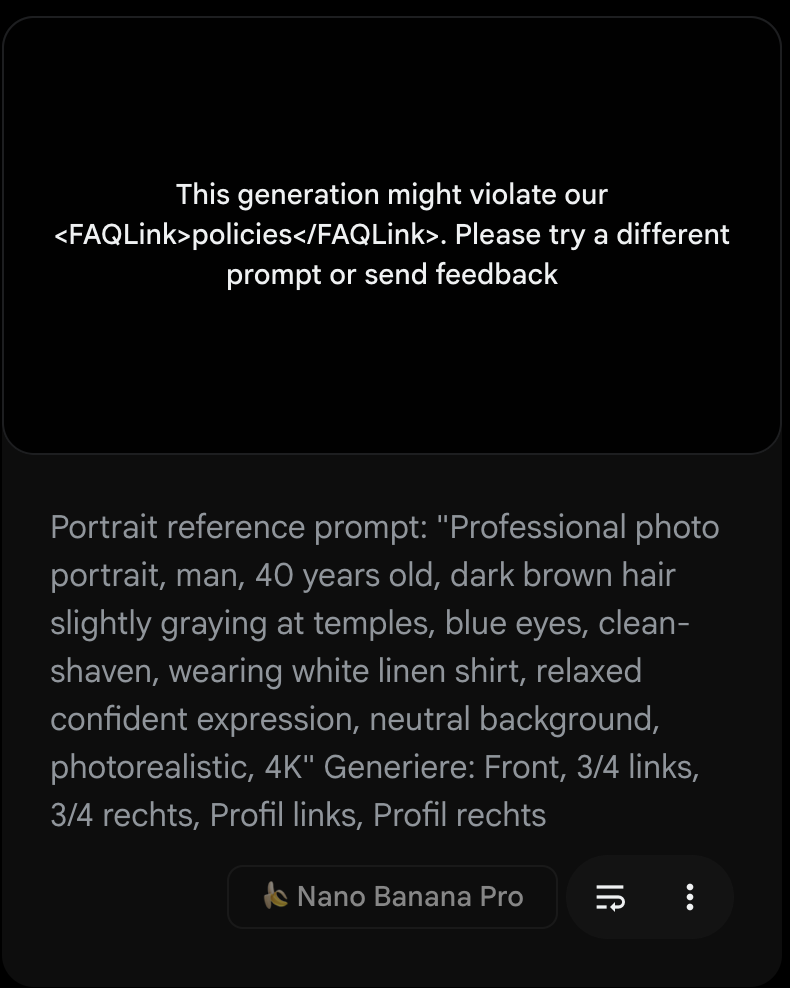

Grok Imagine

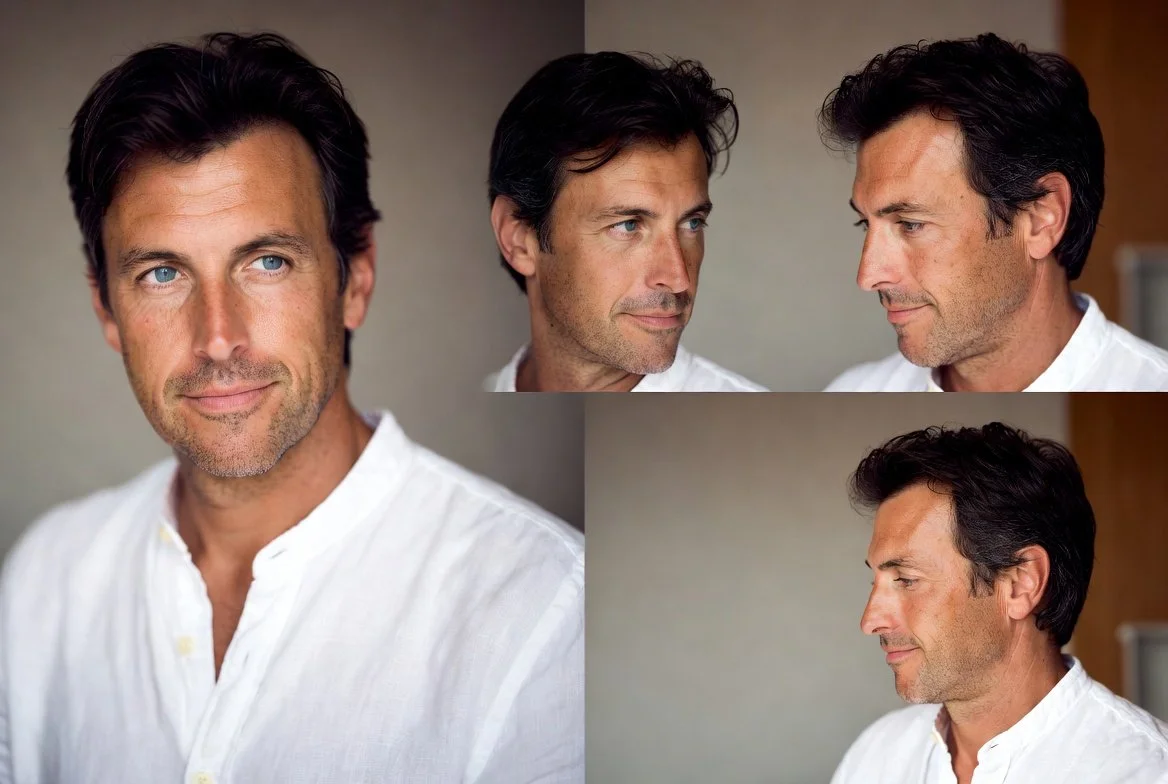

Ein Mann, 40 Jahre alt. Dunkles Haar, graue Schläfen. Ein weißes Leinenhemd. Ein entspannter Blick. Klingt das für Sie nach einer Gefahr für die öffentliche Ordnung? Nach pornografischer Exzessivität oder politischer Radikalisierung?

Für Nano Banana Pro (und stellvertretend für die Logik fast aller aktuellen Bildgeneratoren) offenbar schon.

Der Screenshot, den wir heute betrachten, ist ein Dokument des Scheiterns. Nicht des technischen Scheiterns – die KI könnte dieses Bild generieren –, sondern des ideologischen. Der Prompt war von einer geradezu aggressiven Harmlosigkeit. Kein "in the style of Helmut Newton", keine "wet look"-Attribute, keine zweideutigen Posen. Einfach nur ein Mann in einem Hemd.

Das Ergebnis: "This generation might violate our policies." Der Bildschirm bleibt schwarz. Die Kamera sagt Nein.

Die Neurose der "Safety by Design"

Wir erleben hier die Endstufe dessen, was ich gerne als die digitale Gouvernante bezeichne. Die großen Tech-Unternehmen in den Vereingten Staaten und China haben, getrieben von der Angst vor PR-Desastern und Regulierung, ihre Modelle in ein Korsett aus puritanischen Sicherheitsrichtlinien gezwängt, das so eng geschnürt ist, dass dem kreativen Prozess die Luft wegbleibt.

Das Problem ist nicht der Filter an sich, sondern die Kontextblindheit und die Hyper-Sensibilität. Warum wurde dieser Prompt abgelehnt? Wir wissen es nicht. Das ist das Foucault’sche Panoptikum in digitaler Form: Wir werden diszipliniert, ohne die Regeln genau zu kennen.

War es das "white linen shirt"? (Könnte bei bestimmtem Licht transparent wirken – ein sichtbarer Männeroberkörper - Alarm!)

War es "clean-shaven"? (Ein Wort, das auch in anderen Kontexten auftaucht – Blockieren!)

War es gar die Kombination aus "Portrait" und "Photo"? (Gefahr von Deepfakes realer Personen – Sicher ist sicher!)

Die KI agiert hier nicht als intelligenter Kurator, sondern als hysterischer Zensor, der in jedem Schatten ein Monster vermutet.

Der Hays Code des 21. Jahrhunderts

Wir befinden uns historisch an einem Punkt, der frappierend an Hollywood in den 1930er Jahren erinnert. Damals führte die Filmindustrie den "Hays Code" ein – eine Selbstzensur, um staatlichen Eingriffen zuvorzukommen. Küsse durften nicht länger als drei Sekunden dauern, Ehebruch durfte niemals ungestraft bleiben. Heute sind es nicht katholische Sittenwächter, sondern Risikokapitalgeber und Werbekunden, die den moralischen Kompass justieren. Doch das Ergebnis ist dasselbe: Eine sterilisierte Kunstform, die vor lauter Angst, jemanden zu beleidigen, aufhört, irgendetwas Relevantes auszusagen.

Der Verlust der Unschuld (des Bildes)

In der analogen Fotografie gibt es eine Unschuld der Aufnahme. Wenn ich früher mit einer 801 auf die Straße ging und einen Mann im Leinenhemd fotografierte, dann war da ein Mann im Leinenhemd. Der Film urteilt nicht. Die Chemie hat keine Moral. Das Licht fällt auf das gewählte Filmmaterial, und das latente Bild entsteht, der Entwicklung harrend. Gleiches galt, wenngleich mit ein wenig weniger Magie, für die digitale Fotografie.

Die synthetische Bildgenese hingegen ist ein moralischer Akt. Bevor das erste Pixel gesetzt wird, hat das Modell den Wunsch des Nutzers bereits durch einen ethischen Fleischwolf gedreht. Das Resultat ist eine sterilisierte Welt. Eine Welt, in der Leinenhemden verdächtig sind und Haut per se als "NSFW" (Not Safe For Work) gilt.

Jean Baudrillard schrieb über die Simulacra, die Abbilder ohne Original. Wir bewegen uns auf eine Ära zu, in der diese Simulacra nicht nur künstlich sind, sondern auch lobotomiert. Wir erschaffen eine visuelle Kultur der absoluten Gefahrlosigkeit, eine "Disneyfizierung" der Realität, in der Ecken, Kanten und selbst die simple Textur eines Stoffes weggeschliffen werden, wenn sie auch nur im Entferntesten gegen eine obskure "Policy" verstoßen könnten.

Die Entmündigung des Creators

Was macht das mit uns, den Autoren dieser Bilder? Wir beginnen, uns selbst zu zensieren. Wir schreiben Prompts wie Anwälte, die versuchen, Schlupflöcher in einem Vertrag zu finden. Wir vermeiden Begriffe wie "Haut", "Licht", "Textur", "Körper", nur um nicht den Zorn des Algorithmus zu wecken. Das ist das Gegenteil von Kreativität. Es ist Gehorsam.

Dieser abgelehnte Prompt ist banal. Aber genau in dieser Banalität liegt die Gefahr. Es ist kein Skandal – denn Skandale setzen Öffentlichkeit voraus, und dies geschieht im Stillen –, es ist eine schleichende Bedrohung. Wenn wir nicht einmal mehr das Alltägliche abbilden dürfen, ohne unter Generalverdacht zu stehen, dann ist das Werkzeug kaputt. Oder vielmehr: Das Werkzeug wurde uns aus der Hand genommen. Wir sind nur noch Bittsteller, die hoffen, dass die Maschine heute einen guten Tag hat.

Vielleicht werden wir eines Tages tatsächlich zurück in das Analoge flüchten müssen, in ein Offline-Exil. Die Nikon FM2 hat keine "Content Policy", und einem Ilford HP5 ist es völlig egal, was seine Silberbromide schwärzt. Die Chemie kennt keine Moral, nur Licht und Schatten. Das ist die letzte Bastion der unzensierten Realität. Schade nur, dass es die meisten alten Filmsorten nicht mehr gibt; stattdessen sehen wir uns einer Inflation von Hipster-Filmmarken mit identischen Rezepten zu fürstlichen Preisen gegenüber. Aber das ist Stoff für einen anderen Rant zu einer anderen Zeit.